Censura nas Eleições

As Eleições de 2024 correm sério risco de censura. Alexandre de Moraes criou um “grupo de estudo” no TSE focado no “enfrentamento a desinformação”.

Em Janeiro de 2024, através de uma portaria, o TSE instituiu um “Comitê de Estudos sobre Integridade Digital e Transparência nas Plataformas de Internet no Processo Eleitoral”. Será um grupo “multidisciplinar”, composto por dez pessoas no total, presidido por Alexandre de Moraes e com foco de “enfrentamento à desinformação”. O que preocupa é o histórico e a parcialidade dos participantes desse grupo.

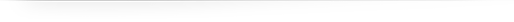

1. José Fernando Moraes Chuy Ex-delegado federal, da área de combate ao terrorismo, Chuy tem histórico de atuação com Moraes e Fachin. Ele foi exonerado da PF durante o governo Bolsonaro após criticar um projeto de lei sobre antiterrorismo de autoria do líder do governo na Câmara, Major Vitor Hugo (PSL-GO). Segundo O Globo, Chuy foi assessor de Alexandre de Moraes enquanto esse era Ministro da Justiça. Ele também trabalhou no “Programa de Enfrentamento à Desinformação” do TSE durante a gestão de Edson Fachin em 2022.

2. Laura Schertel Mendes Laura é professora com extenso currículo de graduações nacionais e internacionais. Atuou fortemente na elaboração da LGPD. Ela tem um livro só sobre a regulação da internet. E acontece que também é filha do ministro Gilmar Mendes.

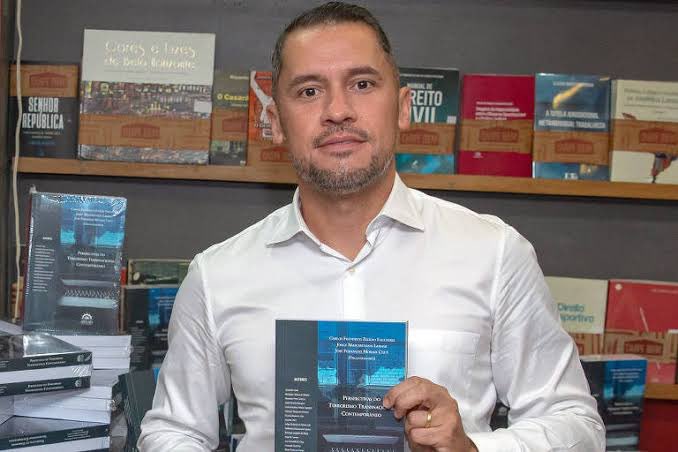

3. Francisco Carvalho de Brito Cruz Francisco é diretor executivo da InternetLab, uma ONG voltada para “pesquisa acadêmica sobretudo no campo da internet”. Na prática, a InternetLab produz relatórios e pesquisas de viés progressista com os clássicos temas de “discurso de ódio”, “defesa da democracia”, “diversidade lgbt”… A ONG, em seu site, declara apoio a instituições globalistas como a Open Society, de George Soros, e a Ford Foundation. Francisco é seguido por Lula no X (antigo Twitter) e tem seu nome mencionado em artigos no site do PT.

4. Beatriz Kira Kira é professora, também com farto currículo acadêmico. Segundo ela mesma, sua agenda de pesquisa se concentra “na regulação de plataformas digitais e na supervisão do poder econômico de empresas de tecnologia”. Também foi coordenadora de pesquisa do InternetLab, mesma ONG de Francisco. Durante o governo Dilma, participou de programas de secretarias do Ministério da Justiça e da Casa Civil.

5. Bruno Ricardo Bioni Bruno é fundador da Data Privacy Brasil, organização voltada para a proteção e regulação de dados na internet. Em seu Instagram, ostenta foto em comemoração de aniversário com Orlando Silva, relator da PL das Fake News, e Francisco Carvalho, da InternetLab. Na legenda: “amigos que a luta a favor da democracia me deram”

6. Clara Iglesias Keller Clara é advogada e pesquisadora especializada em regulação das redes, já tendo trabalhado em conjunto com a Data Privacy Brasil, de Bruno. Em seu perfil do X (antigo Twitter), afirmou que os apoiadores de Bolsonaro chegaram a ser piores que os de Trump em protestos durante a pandemia. Ela também apresenta um viés progressista ao se posicionar em favor do aborto nessa rede.

7. Gabriel Campos Soares da Fonseca Gabriel é universitário e assessor da presidência do STF. Também fez parte da coordenação do livro “Eleições e Democracia na Era Digital”, que foi lançado no TSE em 2022.

8. Nina Fernandes dos Santos Nina é diretora do Aláfia Lab, outra ONG progressista de pesquisa apoiada pela Open Society de George Soros. Ela escreve principalmente sobre o combate às “fake news” e as políticas de ação contra isso. Em suas redes, também demonstra claro apoio ao Lula e ao PT.

Para fechar com chave de ouro: o tal “comitê” tem Alexandre de Moraes como presidente e Carmen Lúcia como vice. Fica evidente que esses tais “especialistas” fazem parte de uma mesma bolha e são completamente parciais em sua ideologia. O que não fica claro é qual será o trabalho desse povo todo, apenas que serão comandos por Alexandre. Procurado pela Gazeta do Povo com esses questionamentos, o TSE não respondeu.

Vale lembrar que nas eleições de 2022 tivemos uma clara atuação de censura por parte do TSE. Pelo jeito, eles planejam repetir a ação, mas agora de forma mais intensa e organizada. Será que estamos diante de um “comitê da censura”!? Compartilhe esse conteúdo e ajude a espalhar esses fatos!!

Fonte: https://twitter.com/guikilter/status/1750142516295246175

esperança de Milei para os latinos

Você deveria ouvir o incrível discurso que Javier Milei fez recentemente em Davos, a reunião anual dos grandes e bons em um recanto nevado da Suíça, onde nossos senhores discutem o que vão fazer conosco a seguir.

O novo presidente da Argentina disse que eles deveriam parar de fazer isso. Desregulamentar. Fechar o banco central. Parar de “proteger” um grupo de pessoas às custas de outro grupo. É um liberalismo que salvará os argentinos deles mesmos, caso o permitam. Rezem pela Argentina. E pelo Brasil.

O discurso está em espanhol no YouTube. Como uma idiota monoglota —isto é, uma “gringa”—, eu tive de escutá-lo em inglês. Espero que haja uma tradução em português.

Cuidado. Você pode ouvir pequenos trechos dele em inglês filtrados através dos preconceitos de, por exemplo, o jornal britânico de esquerda The Guardian, em que Milei e suas propostas são descritos como “conservadores”. Procure o discurso completo e julgue por si mesmo.

Ele diz o que eu venho dizendo, e o que é dito por liberais como o incrível Fórum da Liberdade em Porto Alegre e as diversas filiais dos Students for Liberty em todo o Brasil. É simples: deixem as pessoas terem igualdade de permissão. Tirem os obstáculos do caminho.

Mas muitas coisas são simples. O socialismo é simples: tire de Pedro para dar a Paulo, e chame isso de “justiça social”. O fascismo é simples: a mesma fórmula. Mas o liberalismo tem a vantagem única em relação a esses dois lunatismos modernos de ser são e verdadeiro, do ponto de vista histórico e econômico. Como relata Milei, o liberalismo enriqueceu o mundo e nos fez adultos. Devemos querer ser adultos, e não as eternas crianças ou escravos sob as outras filosofias políticas.

O entendimento de Milei da economia e da política é muito bom. Em especial, ele compreende que a discussão entre economistas sobre “imperfeições” nos mercados trata-se, na maior parte, de contos de fadas sem base científica. Nenhuma.

Ninguém é perfeito. Milei acha que o “capitalismo” é novo. Na verdade, ele começou nas cavernas. O que é novo é o liberalismo iniciado nos anos 1700 entre os anglos, com precedentes em Salamanca, na Espanha. Ele acha que foram as “economias de escala” que nos tornaram ricos, em vez da inovação inspirada pela igualdade de permissão do liberalismo.

Mas é incrível. Escutem.

Fonte: https://www1.folha.uol.com.br/colunas/deirdre-nansen-mccloskey/2024/01/a-esperanca-de-milei-para-os-latinos.shtml

Revisão de estudos conclui que lockdown foi um “fracasso de proporções gigantescas”

Resumo da reportagem

- Revisão que fez triagem de 19.646 estudos, selecionando os 22 melhores, sugere que lockdowns falharam em reduzir mortes e impuseram custos sociais e econômicos significativos.

- Lockdowns causaram efeitos econômicos devastadores, aumentaram a violência doméstica e a doença mental, e minaram a democracia liberal.

- Decisões individuais voluntárias foram mais eficazes do que imposições governamentais na mitigação da crise da Covid-19.

Uma revisão científica feita por três economistas acerca de 19.646 estudos sobre a Covid-19 concluiu que os lockdowns foram uma política global draconiana que fracassou em reduzir de forma significativa as mortes, enquanto impôs custos sociais, culturais e econômicos substanciais. A conclusão preliminar já havia sido divulgada em janeiro de 2022, mas agora integra o livro Os Lockdowns Funcionaram?, do Instituto de Assuntos Econômicos (IEA), uma organização liberal britânica. Ao analisar os quase 20 mil estudos sobre o tema, os pesquisadores levaram em conta a qualidade da amostragem e metodológica, e a temática abordada, chegando a 22 que tratavam especificamente sobre o lockdown.

Os autores definiram lockdown como a imposição de ao menos uma intervenção não farmacêutica, como proibição de aglomerações e fechamento do comércio. O trabalho, que passou pelo crivo de pareceristas anônimos, mostra que o número de mortes evitadas foi irrisório, especialmente quando comparado às promessas que motivaram as medidas. O famoso modelo matemático de março de 2020 do professor Neil Ferguson, do Imperial College em Londres, sugeria que medidas de lockdown reduziriam as 510 mil mortes previstas no Reino Unido para 20 mil. A nova revisão estima que, em toda a Europa, as medidas evitaram apenas seis mil mortes. Para comparação, morrem cerca de 20 mil pessoas anualmente de gripe somente na Inglaterra e País de Gales.

Além disso, ao menos uma medida, a proibição de aglomerações acima de determinado número arbitrário de pessoas (no Reino Unido eram seis), foi associada a um aumentono número de mortes por Covid de 5,9%. No cenário mais otimista possível, os lockdowns reduziram em 10,7% as mortes por Covid na primavera de 2020 no hemisfério norte, quando os surtos começaram. Mais uma vez, isso corresponde a um número de mortes inferior às causadas anualmente pela gripe na Europa (72 mil) e nos Estados Unidos (38 mil).

Não foi por falta de aviso. A revisão mostra que a própria Organização Mundial da Saúde (OMS), em 2019, deu nível “muito baixo” às evidências de eficácia de medidas como fechamento de escolas e ambientes de trabalho, evitar aglomerações, teste de viajantes ao entrar e sair, e fechamento de fronteiras.

Os custos dos lockdowns

Os três economistas apontam diversos estudos que concluíram que as medidas de restrição e confinamento tiveram efeitos “devastadores e extensos” sobre a atividade econômica, o desemprego, na falência de pequenos negócios, aumento da dívida pública, enormes perdas educacionais. Também aumentaram a violência doméstica e a incidência de doenças mentais, “reduziram a liberdade individual, causaram instabilidade política, fortaleceram tendências autoritárias, aumentaram a corrupção dos governos e minaram a democracia liberal”, concluem.

A descoberta deles de que houve um pequeno número de vidas salvas deve ser contrabalançada com as mortes causadas pelos próprios lockdowns. Um estudo citado concluiu que, de abril de 2020 até o fim de 2021, 97 mil americanos morreram, um número excedente comparado às tendências anteriores, por causas que não foram a Covid-19. Algumas causas imediatas apontadas são hipertensão, doença cardíaca, diabetes, obesidade, uso de drogas ilícitas e álcool. São causas que têm a ver com decisões individuais, mas, como dizem os autores, há contribuição dos lockdowns pois “tornaram mais difícil para as pessoas lidar com a pandemia”.

Comportamento voluntário é mais eficaz que imposições

De acordo com autores, nas situações em que houve mitigação da crise, isso se deveu muito mais a decisões individuais voluntárias do que a imposições de governos. “Para aqueles que valorizam a liberdade”, comentam os cientistas, “nossas descobertas são preocupantes, se não deprimentes”. Para eles, a pandemia de Covid-19 deu vazão a “algumas das maiores violações às liberdades individuais em tempos de paz na história” e essas medidas geraram “benefícios desprezíveis à saúde pública enquanto impuseram custos enormes à sociedade”. A análise custo-benefício revela “um fracasso em política global de proporções gigantescas”.

“A nossa metanálise sugere que, quando os pesquisadores levam em conta variáveis adicionais tais como o comportamento voluntário, o impacto dos lockdowns se torna desprezível”, comentou Jonas Herby, um dos autores, que atua como consultor especial do Centro de Estudos Políticos (CEPOS) de Copenhague, Dinamarca.

Os outros autores são Lars Jonung, professor emérito do Departamento de Economia da Universidade de Lund, na Suécia, ex-consultor de pesquisa da Comissão Europeia; e Steve Hanke, professor do Instituto Johns Hopkins de Economia Aplicada, nos Estados Unidos, ex-conselheiro econômico do presidente Ronald Reagan.

Na Suécia, país desenvolvido que menos impôs restrições compulsórias a seus cidadãos, os idosos, grupo mais vulnerável à doença, decidiam voluntariamente não ir a lojas e restaurantes em momentos críticos de ondas da Covid, por exemplo. Essas decisões eram sugeridas pelo governo, sem imposições e criminalizações. A Suécia terminou com o melhor resultado em excesso de mortalidade de toda a Europa.

Os autores da revisão creditam o comportamento da Suécia à sua Constituição, que diz, no artigo oitavo de seu segundo capítulo, que “todos serão protegidos em suas relações com as instituições públicas contra privações da liberdade pessoal” e “todos os cidadãos suecos terão também, em outros aspectos, liberdade de movimentação garantida no Reino e liberdade de sair do Reino” — sem exceção para emergências em tempos de paz. Além da base constitucional, têm crédito dois epidemiologistas da Agência Pública de Saúde sueca que se determinaram a ignorar clamores mundiais por lockdown: Johan Giesecke e Anders Tegnell.

Os cientistas comentam que a publicação preliminar das conclusões, em janeiro do ano passado, atraiu na maior parte atenção “negativa e repetitiva” da imprensa. Eles oferecem um apêndice do livro em que argumentam que a cobertura da imprensa foi “enviesada” e relatam que enfrentaram uma recusa sem precedentes de publicação de uma versão de seu artigo no banco de artigos preliminares SSRN (sigla em inglês para “Rede de Pesquisa em Ciências Sociais”), em julho de 2021.

A pretensão do conhecimento

Friedrich Hayek foi um economista e filósofo austríaco, e é um dos maiores representantes da Escola Austríaca de pensamento econômico. Ganhador do Prêmio Nobel em Economia, foi um defensor do liberalismo clássico. O texto reproduzido foi proferido da ocasião do recebimento do seu Nobel.

A ocasião especial dessa conferência, juntamente com o principal problema prático que os economistas enfrentam atualmente, tornaram a escolha deste tópico praticamente inevitável. Por um lado, a ainda recente criação do Prêmio Nobel em Ciências Econômicas é um passo significativo no processo pelo qual, na opinião do público geral, foi concedida à ciência econômica um pouco da dignidade e do prestígio das ciências físicas. Por outro lado, os economistas estão hoje sendo chamados para salvar o mundo livre da séria ameaça da aceleração inflacionária, que foi causada — devemos admitir — pelas mesmas políticas que a maioria dos economistas recomenda, com grande insistência, que os governos adotem. Com efeito, resta-nos nesse momento poucos motivos de orgulho: como profissionais, criamos uma enorme bagunça.

Parece-me que essa incapacidade dos economistas em sugerir políticas mais bem sucedidas está intimamente ligada à propensão a imitar, o mais rigorosamente possível, os procedimentos das mais brilhantemente exitosas ciências físicas — tentativa essa que, em nosso campo profissional, pode levar a erros crassos. Esta é uma abordagem que passou a ser descrita como sendo uma atitude “cientificista” — uma atitude que, como defini há cerca de trinta anos, “é decididamente não científica no verdadeiro sentido do termo, pois envolve uma aplicação mecânica e indiscriminada de hábitos de pensamento a campos diferentes daqueles em que esses hábitos foram formados”[1] Quero hoje iniciar essa palestra explicando como alguns dos mais graves erros da atual política econômica decorrem diretamente desse erro científico.

A teoria que tem orientado as políticas fiscais e monetárias dos últimos trinta anos — uma teoria que afirmo ser o produto de uma concepção distorcida sobre o procedimento científico adequado — consiste na crença de que existe uma simples correlação positiva entre o nível de emprego e o tamanho da demanda agregada por bens e serviços. Tal crença nos leva a imaginar que podemos garantir permanentemente o pleno emprego através da manutenção dos gastos monetários totais em um nível adequado. Dentre as várias teorias utilizadas para se explicar o alto desemprego, esta é provavelmente a única que pode receber o apoio de fortes evidências quantitativas. Contudo, considero tal teoria fundamentalmente falsa. Mais ainda: agir tomando-a como base é algo, como estamos constatando, extremamente nocivo.

O que nos leva à questão crucial: a diferença entre a Ciência Econômica e as Ciências Físicas. Ao contrário das ciências físicas, na ciência econômica — e em outras disciplinas que lidam com fenômenos essencialmente complexos — os aspectos dos eventos a serem estudados, e sobre os quais podemos coletar dados quantitativos, são necessariamente limitados. Além disso, esse número necessariamente limitado de aspectos quantitativos pode não incluir aqueles aspectos mais importantes. Nas ciências físicas geralmente se supõe, provavelmente com boas razões, que qualquer fator importante na determinação dos eventos observados é ele próprio diretamente observável e mensurável. Já no estudo de fenômenos essencialmente complexos — tais como o mercado, que depende das ações de vários indivíduos —, todas as circunstâncias que irão determinar o resultado de um processo dificilmente serão totalmente conhecidas ou mesmo mensuráveis. Explicarei mais adiante os motivos que me levam a esta afirmação. Assim, ao passo que nas ciências físicas o pesquisador é capaz de mensurar, com base em uma teoria aparentemente evidente, aquilo que ele julga ser importante, nas ciências sociais frequentemente só se dá importância àquilo que por ventura possa ser mensurado. Esse modo de pensar é algumas vezes levado ao ponto em que se exige que nossas teorias sejam formuladas de uma maneira que leve em conta apenas grandezas mensuráveis.

Não se pode negar que essa exigência limita arbitrariamente os fatos que podem ser admitidos como possíveis causas dos eventos que ocorrem no mundo real. Essa visão, que é frequentemente e com muita ingenuidade aceita como procedimento científico sólido, tem algumas conseqüências bastante paradoxais. Em relação ao mercado e a outras estruturas sociais similares, sabemos que existem muitos fatores que não podem ser mensurados e sobre os quais temos, na verdade, apenas algumas informações muito genéricas e imprecisas. E como os efeitos desses fatores não podem, em qualquer momento específico, ser confirmados por evidências quantitativas, eles são simplesmente descartados por aqueles que se comprometeram a aceitar apenas aquilo que julgam ser evidência científica. E assim eles seguem em frente, alegremente crendo na ilusão de que os fatores que eles podem mensurar são os únicos que têm relevância.

A correlação entre demanda agregada e nível de emprego, por exemplo, pode apenas ser aproximada; porém, como é a única sobre a qual há dados quantitativos, passa a ser aceita como o único vínculo causal que importa. O que temos aí é uma ótima evidência “científica” para uma teoria falsa. E ela é aceita porque parece ser mais “científica” do que uma teoria que, embora apresente uma explicação válida, é rejeitada apenas porque não há evidências suficientemente quantitativas para embasá-la.

Deixe-me ilustrar isso através de um breve relato sobre o que considero ser a principal causa do amplo desemprego — um relato que também irá explicar por que esse desemprego não pode ser duradouramente sanado pelas políticas inflacionistas recomendadas pela teoria agora em moda. A explicação correta me parece estar na existência de uma considerável discrepância entre, de um lado, a distribuição da demanda entre os diferentes bens e serviços, e, de outro, a forma como a mão-de-obra e outros recursos são alocados para a produção desses bens e serviços. Possuímos um conhecimento “qualitativo” razoável sobre as forças através das quais se dá a correspondência entre a oferta e a demanda nos diferentes setores do sistema econômico, sobre as condições sob as quais essa correspondência se dará e sobre os fatores que podem impedir tal ajuste. Os procedimentos para a descrição desse processo se baseiam em fatos da experiência diária. E, dentre aqueles que se darão ao trabalho de acompanhar a argumentação, poucos questionarão a validade das suposições factuais ou a exatidão lógica das conclusões derivadas delas.

Posto isso, temos, sim, boas razões para acreditar que o desemprego indica que a estrutura dos salários e dos preços relativos foi distorcida (geralmente em decorrência de uma fixação de preços de caráter governamental ou monopolístico), e que, para se restaurar a igualdade entre a demanda e a oferta de mão-de-obra em todos os setores, serão necessárias mudanças nos preços relativos e também algumas realocações de mão-de-obra.

Porém, quando nos pedem alguma evidência quantitativa sobre qual seria a correta estrutura de preços e salários que garantiria uma venda suave e contínua dos produtos e serviços oferecidos, temos de admitir que não dispomos de tal informação. Em outras palavras: sabemos quais as condições gerais para que ocorra aquilo que se convencionou chamar, incorretamente, de “equilíbrio”; mas nunca sabemos quais serão os preços ou salários específicos caso seja deixado ao mercado gerar esse equilíbrio. Podemos apenas dizer quais são as condições adequadas que irão permitir que o mercado estabeleça preços e salários que façam com que oferta e demanda se igualem. Mas jamais seremos capazes de apresentar informações estatísticas que mostrem quanto os preços e salários atuais estão desviados daqueles valores que iriam assegurar um venda contínua da atual oferta de mão-de-obra. Embora esse relato das causas do desemprego seja uma teoria empírica — no sentido de que se pode provar que é falsa; por exemplo, se, com uma oferta monetária constante, um aumento geral dos salários não levar ao desemprego —, certamente não se trata do tipo de teoria que poderíamos utilizar para obtermos previsões numéricas específicas sobre qual seria distribuição de mão-de-obra e o nível salarial esperados.

Entretanto, por que deveríamos, nas ciências econômicas, confessar nossa ignorância quanto a determinados fatos que, no caso de uma teoria física, certamente exigiriam que um cientista fornecesse informações precisas sobre eles? Não é nada surpreendente que aqueles que se impressionam com as ciências físicas achem essa posição muito insatisfatória e insistam nos tipos de teste utilizados por aquele ramo. Mas há uma razão para ser assim: como já mencionei abreviadamente, as ciências sociais — como grande parte das ciências biológicas, porém ao contrário da maioria da ciências físicas — lidam com estruturas de complexidade essencial, ou seja, com estruturas cujas propriedades características podem ser exibidas somente por modelos compostos por um número relativamente grande de variáveis. A concorrência, por exemplo, é um processo que só produzirá certos resultados caso ocorra entre um número razoavelmente grande de pessoas agindo.

Em alguns estudos, particularmente quando problemas similares surgem nas ciências físicas, as dificuldades podem ser superadas pelo uso de dados sobre a frequência relativa — ou probabilidade — da ocorrência de várias propriedades singulares dos elementos, ao invés de se utilizar informações específicas sobre os elementos individuais. Mas isso é válido somente quando lidamos com aquilo que foi chamado pelo Dr. Warren Weaver (ex-membro da Fundação Rockefeller), com notável precisão, de “fenômenos de complexidade desorganizada”, em contraposição aos “fenômenos de complexidade organizada” com os quais lidamos nas ciências sociais.[2]

Complexidade organizada, nesse caso, significa que a natureza das estruturas que apresentam essa complexidade depende não apenas das propriedades dos elementos individuais que compõem essas estruturas, ou da frequência relativa com que ocorrem, mas também da maneira como os elementos individuais se conectam entre si. Na explicação sobre o funcionamento de tais estruturas, não podemos, por essa razão, substituir as informações sobre os elementos individuais por informações estatísticas; se, com nossa teoria, queremos extrair prognósticos específicos sobre eventos individuais, temos de exigir informações completas sobre cada elemento. Sem essas informações específicas sobre os elementos individuais, estaremos confinados ao que em outra ocasião chamei de meras “previsões de padrão” — previsões sobre alguns dos atributos gerais das estruturas que se formarão, porém destituídas de quaisquer declarações específicas sobre os elementos individuais que formarão essas estruturas.[3]

Isso é particularmente verdade para as nossas teorias que explicam como se dá a formação de salários e preços relativos em um mercado que tenha um bom funcionamento. Para a determinação desses salários e preços, são levados em consideração os efeitos das informações particulares que cada um dos participantes do processo de mercado possui — uma soma de fatores que, em sua totalidade, não podem ser apreendidos pelo observador científico ou por qualquer outro cérebro isolado. A superioridade da ordem de mercado — e a razão por que esta ordem regularmente sobrepuja outros tipos de ordem, quando não suprimida pelos poderes governamentais — está justamente em como se dá a alocação de recursos. Para tal, utiliza-se o conhecimento de fatores particulares que estão dispersos entre um número incontável de pessoas. Esses fatores particulares são tantos, e dispersos de tal maneira, que é impossível que um único indivíduo armazene tais informações. Mas como nós, os cientistas observadores, jamais poderemos saber quais são os determinantes dessa ordem — e, como consequência, somos também incapazes de saber sob qual estrutura específica de preços e salários a demanda será igual à oferta em todo o mercado —, ficamos incapacitados de medir qual é o desvio em relação a essa ordem. Da mesma forma, também não podemos testar estatisticamente a nossa teoria de que são os desvios em relação àquele sistema que “equilibra” preços e salários que tornam impossível vender alguns desses produtos e serviços pelos seus preços de oferta.

Mas antes de continuar analisando os efeitos de tudo isso sobre as políticas de emprego atualmente adotadas, permitam-me definir mais especificamente as limitações intrínsecas do nosso conhecimento numérico, limitações estas que frequentemente são desconsideradas. Quero fazer isso para não dar a impressão de que rejeito generalizadamente o método matemático em economia. Com efeito, a grande vantagem da técnica matemática é que ela nos permite descrever, por meio de equações algébricas, a natureza geral de um padrão, mesmo quando desconhecemos os valores numéricos que irão determinar a manifestação desse padrão. Sem essa técnica algébrica, dificilmente teríamos alcançado aquela descrição abrangente das interdependências mútuas dos diferentes eventos em um mercado. Entretanto, criou-se a ilusão de que podemos utilizar essa técnica para a determinação e previsão dos valores numéricos dessas magnitudes; e isso levou a uma inútil busca por constantes quantitativas ou numéricas.

Isso aconteceu apesar de os fundadores modernos da economia matemática não terem tais ilusões. É verdade que seus sistemas de equações descrevendo o padrão de um equilíbrio de mercado são aparentemente tão abrangentes que se preenchêssemos todas as variáveis dessas fórmulas abstratas — isto é, se soubéssemos todos os parâmetros dessas equações — seríamos capazes de calcular os preços e quantidades de todas as mercadorias e serviços vendidos. Porém, como Vilfredo Pareto, um dos fundadores dessa teoria, afirmou claramente, o propósito desse sistema de equações não é “possibilitar um cálculo numérico dos preços”, porque, como ele disse, seria “absurdo” supor que podemos determinar todos os dados.[4] De fato, o ponto principal já havia sido entendido por aqueles notáveis visionários da economia moderna, os escolásticos espanhóis do século XVI, que enfatizaram que aquilo que chamavam de pretium mathematicum — o preço matemático — dependia de tantas circunstâncias particulares que era impossível que o homem conhecesse todas elas. Somente Deus teria tal capacidade.[5]

Algumas vezes já desejei que nossos economistas matemáticos levassem a sério essa consideração. Devo confessar que ainda tenho dúvidas se suas buscas por magnitudes mensuráveis trouxeram contribuições significativas à nossa compreensão teórica dos fenômenos econômicos — em contraposição à utilidade que elas possuem para descrever situações particulares. Também não estou preparado para aceitar a desculpa de que esse ramo de pesquisa é ainda muito jovem: afinal, Sir William Petty, o fundador de econometria, foi praticamente um colega sênior de sir Isaac Newton na Royal Society!

Podem até serem poucos os casos de danos reais no campo econômico causados pela crença de que apenas magnitudes mensuráveis são importantes. Porém, os atuais problemas com a inflação e o desemprego representam um desses casos — e um extremamente sério. Seu efeito foi fazer com que a maioria dos economistas de mentalidade cientificista negligenciasse aquela que provavelmente é a verdadeira causa do amplo desemprego, uma vez que a ação desta causa não pode ser confirmada por relações diretamente observáveis entre magnitudes mensuráveis. Uma atenção quase exclusiva sobre fenômenos superficiais que são quantitativamente mensuráveis gerou uma política que tem piorado a situação cada vez mais.

Devo, é claro, prontamente admitir que o tipo de teoria que considero como sendo a verdadeira explicação para o desemprego é uma teoria cujo conteúdo é um tanto limitado. E assim o é porque ela nos permite fazer apenas prognósticos muito generalizados sobre os tipos de eventos que devemos esperar em uma dada situação. Por outro lado, as conseqüências das teorias mais ambiciosas não têm sido muito venturosas. E confesso que prefiro um conhecimento imperfeito, porém verdadeiro — mesmo que deixe muitas coisas indeterminadas e seja incapaz de fazer previsões —, a um pretenso conhecimento exato, mas provavelmente falso. A credibilidade que teorias aparentemente simples, porém falsas, podem ganhar em decorrência de sua conformidade com padrões científicos reconhecidos pode levar a graves conseqüências, como a presente situação comprova.

De fato, no assunto em questão — o desemprego —, as mesmas medidas que a teoria “macroeconômica” dominante tem recomendado para se curar o desemprego — a saber, o aumento da demanda agregada — se tornaram a causa de uma vasta má alocação de recursos, o que certamente irá tornar inevitável um desemprego em larga escala, no futuro. A contínua injeção de quantias adicionais de dinheiro gera, em alguns pontos do sistema econômico, uma demanda temporária que inevitavelmente irá acabar assim que o aumento da quantidade monetária parar ou desacelerar. Essas injeções monetárias, juntamente com a expectativa de um contínuo aumento nos preços, direcionam mão-de-obra e outros recursos para empregos que irão durar somente enquanto a expansão da quantidade de dinheiro continuar na mesma taxa — ou até mesmo somente enquanto a expansão monetária continuar a uma taxa crescente.

Essa política, ao contrário do que dizem alguns, não produziu um nível de emprego que não pudesse ter sido criado de outras maneiras; ela produziu, isto sim, uma distribuição do emprego que não pode ser indefinidamente mantida e que, após algum tempo, será preservada apenas se houver uma taxa de inflação tão grande que inevitavelmente levará à desorganização de toda a atividade econômica. O fato é que, em decorrência de uma visão teórica equivocada, fomos levados a uma posição precária, em que não mais podemos impedir que um substancial desemprego reapareça; não porque esse desemprego irá ser deliberadamente gerado como instrumento de combate à inflação — como alguns, equivocadamente, interpretam essa visão —, mas, sim, porque, tão logo a inflação monetária desacelere, o desemprego passará a ser uma lastimável porém inevitável conseqüência das políticas equivocadas do passado.

Relatei esses problemas, cuja importância prática é imediata, principalmente para ilustrar as conseqüências significativas dos erros relacionados a problemas abstratos da filosofia da ciência. Há inúmeras razões para estarmos apreensivos quanto aos perigos de longo prazo criados pela aceitação indiscriminada de afirmações que aparentam serem científicas.

Meu principal intuito foi demonstrar, através de exemplos localizados, que — em relação aos assuntos de minha área e, de forma mais, geral, aos de todas as ciências humanas — certos procedimentos, aparentemente muito científicos, são, frequentemente, os que, na verdade, têm o menor grau de cientificidade. Além disso, nessas outras atividades há limites definitivos com relação ao que se espera que a ciência possa realizar. Confiar à ciência — ou à possibilidade de deliberadamente se exercer qualquer controle baseado em princípios científicos — mais do que o método científico pode conseguir, certamente acarretará efeitos deploráveis. É verdade, todavia, que atualmente o progresso das ciências naturais tem em tal ponto excedido as expectativas, que qualquer alusão à existência de limites às suas possibilidades corre o risco de ficar sob suspeita.

Este modo de ver os fatos vai encontrar resistência especialmente por parte daqueles que alimentavam a esperança de que nosso crescente poder de previsão e controle — geralmente atribuído ao avanço científico —, quando aplicado a processos sociais, tornaria possível moldarmos a sociedade de acordo com o nosso gosto. É certamente verdade que, ao contrário das descobertas das ciências físicas, que tendem a provocar muito entusiasmo, as ideias que formamos a partir do estudo da sociedade têm, na maior parte das vezes, produzido um efeito deletério em nossas aspirações. Não surpreende, por outro lado, que os nossos mais jovens e impetuosos colegas de profissão nem sempre estejam preparados para aceitar essa verdade, não obstante a confiança no poder ilimitado da ciência frequentemente se basear na falsa crença de que o método científico consiste na aplicação de uma técnica “pré-fabricada”, ou na simples imitação da forma — e não da substância — do processo científico, como se alguém precisasse seguir as receitas de um manual de culinária para resolver todos os problemas sociais. Às vezes, parece mais fácil aprender técnicas científicas do que usar os processos de raciocínio que podem nos mostrar quais são os problemas e como abordá-los.

O conflito entre o que o público — em seu estado atual de espírito — espera da ciência quanto à satisfação dos seus próprios anseios e o que ela pode realmente oferecer é uma questão muito séria. Mesmo que todos os verdadeiros cientistas reconhecessem as limitações do que são capazes de fazer no campo das ciências humanas, enquanto houver esperanças da parte do público, sempre haverá quem finja — ou talvez mesmo quem acredite honestamente — que pode fazer anseios populares, mais do que efetivamente pode. Até mesmo para especialistas é muitas vezes difícil — e é certamente impossível para o leigo, em muitas ocasiões — distinguir entre pretensões justificáveis e injustificáveis, levantadas em nome da ciência. Por exemplo, os mesmos meios de comunicação que deram enorme publicidade a um relatório que, em nome da ciência, tratava dos limites do crescimento, silenciaram totalmente quanto à crítica devastadora feita por especialistas competentes a este relatório[6]. Este exemplo nos faz ficar bastante apreensivos quanto ao que se pode fazer em nome do prestígio da ciência.

Por outro lado, não é, de modo algum, apenas na economia que se fazem ousadas reivindicações no sentido de haver um cada vez maior direcionamento científico para todas as atividades humanas, ou que se procuram substituir processos espontâneos por “controle humano consciente”. Se não estou enganado, os campos da psicologia, psiquiatria, alguns ramos da sociologia, além da chamada filosofia da história, são — até mais que a economia — afetados não só por aquilo a que tenho chamado de ‘parcialismo cientificista’ como também por expectativas espúrias com relação ao que a ciência pode proporcionar[7].

Se quisermos preservar a reputação da ciência e evitar esta distorção que quer fazer o conhecimento parecer verdadeiro a partir de uma semelhança meramente superficial com o procedimento das ciências físicas, será preciso muito esforço para que cheguemos a desmascarar essas apropriações indébitas da ciência, algumas das quais já se tornaram direitos adquiridos de reputados departamentos universitários. É impossível sermos suficientemente gratos a alguns modernos filósofos da ciência, como é o caso de Sir Karl Popper, por nos terem legado um “teste” para a distinção entre o que pode e o que não pode ser aceito como científico — teste este pelo qual não passariam algumas doutrinas hoje amplamente aceitas como científicas.

Os fenômenos essencialmente complexos — como são as estruturas sociais — apresentam, porém, problemas específicos que me levam a reformular em termos mais gerais não só as razões pelas quais é maior, para esses campos, o número de obstáculos intransponíveis quando se deseja prever determinados acontecimentos, mas também os motivos que nos levam a agir como se tivéssemos conhecimento científico suficiente para superar tais obstáculos, atitude que dificulta em muito o avanço do intelecto humano.

O mais importante é lembrar que o amplo e rápido desenvolvimento das ciências físicas teve lugar em certas áreas que permitiam basear as explicações e as previsões em leis relacionadas aos fenômenos observados como funções de relativamente poucas variáveis — ou fatos singulares, ou acontecimentos de frequência relativa. Pode-se mesmo considerar que esta seja a razão primordial de distinguirmos esses ramos do conhecimento rotulando-os de “físicos”, ao contrário daqueles que se prendem a estruturas muito mais organizadas, denominadas aqui de “essencialmente complexas”. Não há razão para que se considerem da mesma forma as duas situações.

As dificuldades que encontramos quando lidamos com fenômenos essencialmente complexos não se ligam, como se poderia imediatamente pensar, à formulação de teorias capazes de explicar os acontecimentos observados, muito embora os fenômenos essencialmente complexos acarretem dificuldades especiais em testar as explicações propostas e, consequentemente, em afastar as más teorias. O principal problema que surge quando aplicamos nossas teorias a qualquer situação específica do mundo real é o de que uma teoria a respeito de fenômenos essencialmente complexos deve fundamentar-se em um grande número de fatos particulares. Estes devem, antes de ser base de previsões ou objetos de testes, passar, todos, por severa averiguação.

Se for possível arregimentar este grande número de fatos particulares, não deverá, em princípio, haver dificuldade especial na obtenção de previsões passíveis de prova. Com o auxílio de computadores modernos, deve ser muito fácil inserir esses dados nos espaços em branco das fórmulas teóricas, para obter previsões. A dificuldade real, no entanto, consiste na averiguação dos fatos particulares. Para este problema a ciência tem poucas soluções a oferecer; às vezes, ele é mesmo insolúvel.

Basta um exemplo muito simples para mostrar qual é, de fato, a natureza da dificuldade. Consideremos uma partida de futebol disputada por algumas poucas pessoas de habilidades muito semelhantes. Se, além do nosso conhecimento geral das habilidades individuais dos jogadores, pudéssemos conhecer uns poucos dados particulares, tais como o grau de atenção de cada um, sua capacidade de percepção, bem como suas condições cardíacas, pulmonar, muscular etc., a cada momento da disputa poderíamos provavelmente prever o resultado do jogo. Na verdade, se temos muita familiaridade com o jogo e com as equipes, temos, certamente, uma boa visão dos fatores que determinam o resultado.

Mesmo assim, é logicamente impossível para nós averiguarmos todos os dados particulares de que falamos. Assim, o resultado do jogo fica fora do alcance daquilo que é cientificamente previsível, apesar do muito que podemos saber sobre os efeitos que certos acontecimentos podem exercer no resultado do jogo. Isso não significa porém, que não possamos fazer qualquer previsão sobre o curso do jogo. Se conhecemos as regras de diferentes jogos, ao observarmos um destes jogos, podemos, imediatamente, dizer qual é ele e que tipos de jogadas podemos ou não esperar que os jogadores façam. Mas nossa capacidade de prever estará sempre restrita a estas características gerais dos acontecimentos possíveis: não poderemos prever particularidades de acontecimentos únicos.

Essa explicação corresponde ao que antes chamei de simples previsão de padrões. A eles vamo-nos prendendo cada vez mais à medida que vamos saindo de áreas onde predominam leis relativamente simples, e nos adentrando na classe de fenômenos caracterizados por regras de complexidade organizada. Quanto mais avançamos nessa direção, maior é a frequência com que pensamos poder efetivamente verificar algumas — mas não todas — circunstâncias que determinam o resultado de um dado processo. Consequentemente, tornamo-nos capazes de prever alguns — mas não todos — elementos que constituem o resultado que, para nós, deve ser esperado. Muitas vezes, no entanto, não é possível prever mais que uma outra característica abstrata do padrão que irá emergir, como as relações entre tipos de elementos, sobre cada um dos quais, particularmente, muito pouco sabemos. Apesar de tudo isso — e quero voltar a frisar este ponto — ainda é possível obtermos previsões que, tendo sido falsificadas, satisfazem o teste de significância empírica de Popper.

É claro que estas simples previsões de padrões, comparadas com o tipo de previsão precisa que aprendemos a esperar no campo das ciências físicas, se apresentam como uma alternativa de segunda categoria. Mas o perigo contra o qual desejo advertir está precisamente na crença de que é preciso conseguir cada vez mais, para reivindicar reconhecimento como ciência. É este o caminho do charlatanismo, ou de coisa pior. Ações baseadas na crença de que possuímos conhecimento e poder tais, que nos permitem moldar os processos sociais inteiramente de acordo com nossa vontade — conhecimento e poder que, na realidade, não possuímos —, provavelmente nos levarão a fazer muito mal.

Quando se trata de ciências físicas, há poucas objeções à tentativa de fazer o impossível. Algumas vezes sentimos até que não devemos desencorajar pessoas superconfiantes, uma vez que suas experiências podem, no fim das contas, trazer novas ideias. Nas ciências sociais, no entanto, o equívoco no sentido de que o exercício de algum poder teria necessariamente consequências benéficas, poderia levar à concessão, a alguma autoridade, de um novo poder que talvez fosse usado para coagir. Este poder talvez não seja mau em si mesmo, mas seu exercício pode vir a obstruir o funcionamento daquelas forças espontâneas coordenadoras que, efetivamente, tanto ajudam os homens na persecução de seus ideais, mesmo que eles não consigam entendê-las.

Já se pode começar a perceber como é sutil o sistema de comunicação no qual se baseia o funcionamento de uma sociedade industrial desenvolvida. Este sistema de comunicação, que chamamos de mercado, vem a ser um mecanismo de condensação de informações dispersas mais eficiente que qualquer outro deliberadamente concebido pelo homem para o mesmo fim.

Se o que os homens pretendem é causar menos danos que benefícios por meio de seus esforços no sentido de aperfeiçoar a ordem social, eles terão de aprender que neste campo — assim como em outros em que predomina a complexidade essencial do tipo organizado — não é possível chegar ao conhecimento pleno que viabilizaria o domínio dos acontecimentos. Terão, portanto, de usar o conhecimento que puderem conseguir, não para moldar resultados, como um artesão em seu trabalho manual, mas para cultivar o crescimento por meio da preparação de um ambiente apropriado, tal como faz o jardineiro com as suas plantas.

É muito perigosa a sensação exuberante do poder sempre crescente que, engendrada pelo avanço das ciências físicas, incentiva o homem a tentar, “inebriado com o sucesso” — para utilizar uma expressão característica dos primórdios do comunismo — submeter tudo o que o cerca, meio ambiente e também seres humanos, ao controle de sua vontade pessoal. O reconhecimento dos limites insuperáveis do seu conhecimento deveria ser, para aquele que estuda a sociedade, uma lição de humildade tal, que ele desejasse manter-se longe de qualquer eventual cumplicidade com o esforço fatal do homem no sentido de controlar a sociedade — esforço que não apenas faz do homem um tirano de seus concidadãos, mas também pode levá-lo a destruir uma civilização que não foi engendrada por cérebro algum: uma civilização que tem prosperado como resultado dos esforços livres de milhões de indivíduos.

Fonte: https://www.mises.org.br/Article.aspx?id=222

O legado de Adam Smith

Adam Smith foi um ícone do Iluminismo escocês/britânico, e ficou conhecido pelo seu estudo sobre a riqueza das nações. Mas seu outro livro clássico, Teoria dos Sentimentos Morais, publicado duas décadas antes, merece igualmente menção em seu legado.

Alguns acham que há incongruências entre os “dois” autores, o jovem Adam Smith, focando na empatia e nos valores morais, e o “maduro”, defendendo a “mão invisível” do mercado, ou seja, o egoísmo como motor do bem-geral, resumido na famosa passagem:

Não é da benevolência do açougueiro, do cervejeiro e do padeiro que esperamos o nosso jantar, mas da consideração que eles têm pelos próprios interesses. Apelamos não à humanidade, mas ao amor-próprio, e nunca falamos de nossas necessidades, mas das vantagens que eles podem obter.

Mas, como argumenta a historiadora Gertrude Himmelfarb em Os caminhos para a modernidade, não há essa divisão entre “eles”. Os dois livros, no fundo, reforçam a mesma mensagem: a de que os indivíduos, num ambiente de liberdade, imersos em valores éticos, acabam produzindo o bem-geral. A preocupação de Smith é com o resultado para a sociedade como um todo, preservando-se a liberdade do indivíduo.

Apesar de publicado só em 1776, A riqueza das nações começou a ser preparado muito antes, antes mesmo da publicação de Teoria dos Sentimentos Morais, em 1759. Smith era, como os demais iluministas britânicos, um filósofo moral acima de tudo. Foi inclusive acusado por Schumpeter de “moralizar” demais a economia, de não dissociá-la da ética e da política.

Smith era um grande defensor da liberdade, e o livre mercado era consequência disso. Mas ele não necessariamente nutria simpatia pelos homens de negócio. Uma passagem deixa isso claro, mostrando também que seu verdadeiro alvo era o mercantilismo, uma espécie de antecessor do atual “capitalismo de compadres”:

Pessoas do mesmo ramo raramente se encontram, mesmo que para uma festa ou diversão; mas a conversa sempre acaba em uma conspiração contra o público ou em alguma invenção para aumentar os preços.

Outra passagem confirma seu receio:

O interesse dos empresários é sempre, em alguns aspectos, diferente, e mesmo oposto, ao do público … A proposta de qualquer nova lei ou regulamentação do comércio que venha dessa ordem … nunca deve ser adotada, até depois de ter sido longa e cuidadosamente examinada … com muita atenção e suspeição.

Ou seja, Smith foi um defensor do “interesse geral”, da sociedade, do povo, do trabalhador, dos mais pobres, da liberdade, e via no livre mercado o melhor instrumento para tanto, assim como no mercantilismo e num governo intervencionista seus maiores inimigos. Seu fim era a “riqueza da nação”, mas ele entendia que o único meio viável era o livre mercado, sem paternalismo ou dirigismo:

Ao perseguir seu próprio interesse (o indivíduo) freqüentemente promove o da sociedade de forma mais eficaz do que quando ele realmente pretende promovê-lo. Nunca conheci nada bem feito por aqueles que enfrentaram o comércio pelo bem público.

O risco das “consequências não-intencionais” de quem quer deliberadamente “salvar o mundo” era bem conhecido por Smith, que preferia depositar na “mão invisível” as esperanças (e de acordo com o que a própria experiência lhe mostrava). Como um bom iluminista escocês, Smith era empírico, realista, e sabia que as ações individuais sem coordenação central levavam ao melhor resultado geral:

O homem do sistema … é capaz de ser muito sábio em sua própria presunção; E muitas vezes está tão apaixonado pela suposta beleza de seu próprio plano de governo ideal, que ele não admite sofrer o menor desvio de qualquer parte … Ele parece imaginar que pode organizar os diferentes membros de uma grande sociedade com tanta facilidade quanto a mão que arruma as diferentes peças sobre um tabuleiro de xadrez. Ele não considera que, no grande tabuleiro da sociedade humana, cada peça tem um princípio de movimento próprio, completamente diferente do que o legislador poderia escolher.

Adam Smith exerceu grande influência em outros pensadores importantes, como Edmund Burke. “Caridade ao pobre é um dever dirigido e obrigatório a todos os cristãos”, reconheceu o irlandês, mas “interferir na subsistência do povo” seria uma violação das leis econômicas e uma intrusão ilegítima da autoridade. Himmelfarb escreve:

Fazendo eco à “mão invisível” de Smith, Burke presta homenagem ao “benigno e sábio distribuidor de todas as coisas, que obriga os homens, queiram eles ou não, a perseguirem seus próprios interesses, a conectarem o bem geral ao seu próprio sucesso individual.

Ambos, Smith e Burke, entendiam, contudo, que esse “milagre” do livre mercado não ocorria num vácuo de valores morais. Ao contrário: somente numa sociedade que valoriza a ética isso seria possível. Adam Smith condenou os “tiranos do bem”, que para criar um “mundo melhor” destruíam a liberdade individual. Mas ele não abraçou a ideia de que as virtudes individuais eram dispensáveis para uma sociedade.

Ao contrário: ele sabia que a empatia pelo próximo era um sentimento natural que devia ser alimentado pelos hábitos. O que Smith queria, no fundo, era um melhor resultado para todos, especialmente para os mais pobres.

Discurso sobre o dinheiro de Francisco D’Anconia em “A Revolta de Atlas” de Ayn Rand

– Então o senhor acha que o dinheiro é a origem de todo o mal? O senhor já se perguntou qual é a origem do dinheiro? Ele é um instrumento de troca, que só pode existir quando há bens produzidos e homens capazes de produzi-los. O dinheiro é a forma material do princípio de que os homens que querem negociar uns com os outros precisam trocar um valor por outro. O dinheiro não é o instrumento dos pidões, que recorrem às lágrimas para pedir produtos, nem dos saqueadores, que os levam à força. O dinheiro só se torna possível por intermédio dos homens que produzem. É isso que o senhor considera mau? Quem aceita dinheiro como pagamento por seu esforço só o faz por saber que será trocado pelo produto do esforço de outrem. Não são os pidões nem os saqueadores que dão ao dinheiro o seu valor. Nem um oceano de lágrimas nem todas as armas do mundo podem transformar aqueles pedaços de papel no seu bolso no pão de que você precisa para sobreviver. Aqueles pedaços de papel, que deveriam ser ouro, são penhores de honra, e é por meio deles que você se apropria da energia dos homens que produzem. A sua carteira afirma a esperança de que em algum lugar no mundo ao seu redor existam homens que não traem aquele princípio moral que é a origem do dinheiro. É isso que o senhor considera mau?

Ninguém respondeu.

– Já procurou a origem da produção? Olhe para um gerador de eletricidade e ouse dizer que ele foi criado pelo esforço muscular de criaturas irracionais. Tente plantar um grão de trigo sem os conhecimentos que lhe foram legados pelos homens que foram os primeiros a fazer isso. Tente obter alimentos usando apenas movimentos físicos e descobrirá que a mente do homem é a origem de todos os produtos e de toda a riqueza que já houve na Terra. Mas o senhor diz que o dinheiro é feito pelos fortes em detrimento dos fracos? A que força se refere? Não à força das armas nem à dos músculos. A riqueza é produto da capacidade humana de pensar. Então o dinheiro é feito pelo homem que inventa um motor em detrimento daqueles que não o inventaram? O dinheiro é feito pela inteligência em detrimento dos estúpidos? Pelos capazes em detrimento dos incompetentes? Pelos ambiciosos em detrimento dos preguiçosos? O dinheiro é feito – antes de poder ser embolsado pelos pidões e pelos saqueadores – pelo esforço honesto de todo homem honesto, cada um na medida de suas capacidades. O homem honesto é aquele que sabe que não pode consumir mais do que produz. Comerciar por meio do dinheiro é o código dos homens de boa vontade. O dinheiro se baseia no axioma de que todo homem é proprietário de sua mente e de seu trabalho. O dinheiro não permite que nenhum poder prescreva o valor do seu trabalho, senão a escolha voluntária do homem que está disposto a trocar com você o trabalho dele. O dinheiro permite que você obtenha em troca dos seus produtos e do seu trabalho aquilo que esses produtos e esse trabalho valem para os homens que os adquirem, nada mais que isso. O dinheiro só permite os negócios em que há benefício mútuo segundo o juízo das partes voluntárias.

– O dinheiro exige o reconhecimento de que os homens precisam trabalhar em benefício próprio, não em detrimento de si próprios. Para lucrar, não para perder. De que os homens não são bestas de carga, que não nascem para arcar com o ônus da miséria. De que é preciso lhes oferecer valores, não dores. De que o vínculo comum entre os homens não é a troca de sofrimento, mas a troca de bens. O dinheiro exige que o senhor venda não a sua fraqueza à estupidez humana, mas o seu talento à razão humana. Exige que compre não o pior que os outros oferecem, mas o melhor que ele pode comprar. E, quando os homens vivem do comércio – com a razão e não à força, como árbitro ao qual não se pode mais apelar –, é o melhor produto que sai vencendo, o melhor desempenho, o homem de melhor juízo e maior capacidade – e o grau da produtividade de um homem é o grau de sua recompensa. Esse é o código da existência, cujos instrumento e símbolo são o dinheiro. É isso que o senhor considera mau?

Todos continuaram em silêncio.

– Mas o dinheiro é só um instrumento. Ele pode levá-lo aonde o senhor quiser, mas não pode substituir o motorista do carro. Ele lhe dá meios de satisfazer seus desejos, mas não lhe cria desejos. O dinheiro é o flagelo dos homens que tentam inverter a lei da causalidade – aqueles que tentam substituir a mente pelo sequestro dos produtos da mente. O dinheiro não compra felicidade para o homem que não sabe o que quer, não lhe dá um código de valores se ele não tem conhecimento a respeito de valores, e não lhe dá um objetivo se ele não escolhe uma meta. O dinheiro não compra inteligência para o estúpido, nem admiração para o covarde, nem respeito para o incompetente. O homem que tenta comprar o cérebro de quem lhe é superior para servi-lo, usando dinheiro para substituir seu juízo, termina vítima dos que lhe são inferiores. Os homens inteligentes o abandonam, mas os trapaceiros e vigaristas correm a ele, atraídos por uma lei que ele não descobriu: o homem não pode ser menor do que o dinheiro que ele possui. É por isso que o senhor considera o dinheiro mau?

– Só o homem que não precisa da fortuna herdada merece herdá-la – aquele que faria sua fortuna de qualquer modo, mesmo sem herança. Se um herdeiro está à altura de sua herança, ela o serve; caso contrário, ela o destrói. Mas o senhor diz que o dinheiro o corrompeu. Foi mesmo? Ou foi o herdeiro que corrompeu seu dinheiro? Não inveje um herdeiro que não vale nada: a riqueza dele não é sua, e o senhor não teria tirado melhor proveito dela. Não pense que ela deveria ser distribuída – criar 50 parasitas em lugar de um só não reaviva a virtude morta que criou a fortuna. O dinheiro é um poder vivo que morre quando se afasta de sua origem. Ele não serve à mente que não está a sua altura. É por isso que o senhor o considera mau?

Antes que alguém pudesse responder, Francisco prosseguiu:

– O dinheiro é o seu meio de sobrevivência. O veredicto que o senhor dá à fonte de seu sustento é aquele que dá à sua própria vida. Se a fonte é corrupta, o senhor condena sua própria existência. O seu dinheiro provém da fraude? Da exploração dos vícios e da estupidez humanos? O senhor o obteve servindo aos insensatos, na esperança de que lhe dessem mais do que sua capacidade merece? Baixando seus padrões de exigência? Fazendo um trabalho que o senhor despreza para compradores que não respeita? Nesse caso, o seu dinheiro não lhe dará um momento sequer de felicidade. Todas as coisas que adquirir serão não um tributo ao senhor, mas uma acusação; não uma realização, mas um momento de vergonha. Então o senhor dirá que o dinheiro é mau. Mau porque ele não substitui seu amor-próprio? Mau porque ele não permite que o senhor aproveite e goze sua depravação? É esse o motivo de seu ódio ao dinheiro? Ele será sempre um efeito e nada jamais o substituirá na posição de causa. O dinheiro é produto da virtude, mas não dá virtude nem redime vícios. Ele não lhe dá o que o senhor não merece, nem em termos materiais nem espirituais. É esse o motivo de seu ódio ao dinheiro? Ou será que o senhor disse que é o amor ao dinheiro que é a origem de todo o mal? Amar uma coisa é conhecer e amar sua natureza.

– Amar o dinheiro é conhecer e amar o fato de que ele é criado pela melhor força que há dentro do senhor, sua chave mestra que lhe permite trocar seu esforço pelo dos melhores homens que há. O homem que venderia a própria alma por um tostão é o que mais alto brada que odeia o dinheiro – e ele tem bons motivos para odiá-lo. Os que amam o dinheiro estão dispostos a trabalhar para ganhá-lo. Eles sabem que são capazes de merecê-lo. Eis uma boa pista para saber o caráter dos homens: aquele que amaldiçoa o dinheiro o obtém de modo desonroso; aquele que o respeita o ganha honestamente. Fuja do homem que diz que o dinheiro é mau. Essa afirmativa é o estigma que identifica o saqueador, assim como o sino indicava o leproso. Enquanto os homens viverem juntos na Terra e precisarem de um meio para negociar, se abandonarem o dinheiro, o único substituto que encontrarão será o cano do fuzil.

Atônitos, os convidados olhavam fixamente para Francisco.

– O dinheiro exige do senhor as mais elevadas virtudes, se quer ganhá-lo ou conservá-lo. Os homens que não têm coragem, orgulho nem amor-próprio, que não têm convicção moral de que merecem o dinheiro que têm e não estão dispostos a defendê-lo como defendem suas próprias vidas, os que pedem desculpas por serem ricos – esses não vão permanecer ricos por muito tempo. São presa fácil para os enxames de saqueadores que vivem debaixo das pedras durante séculos, mas que saem do esconderijo assim que farejam um homem que pede perdão pelo crime de possuir riquezas. Rapidamente eles vão livrá-lo dessa culpa – bem como de sua própria vida, que é o que ele merece. Então o senhor verá a ascensão daqueles que vivem uma vida dupla, que vivem da força, mas dependem dos que vivem do comércio para criar o valor do dinheiro que saqueiam. Esses homens vivem pegando carona com a virtude. Numa sociedade em que há moral, eles são os criminosos, e as leis são feitas para proteger os cidadãos contra eles.

– Mas, quando uma sociedade cria uma categoria de criminosos legítimos e saqueadores legais – homens que usam a força para se apossar da riqueza de vítimas desarmadas –, então o dinheiro se transforma no vingador daqueles que o criaram. Tais saqueadores acham que não há perigo em roubar homens indefesos, depois que aprovam uma lei que os desarme. Mas o produto de seu saque acaba atraindo outros saqueadores, que os saqueiam como eles fizeram com os homens desarmados. E assim a coisa continua, vencendo sempre não o que produz mais, mas aquele que é mais implacável em sua brutalidade. Quando o padrão é a força, o assassino vence o batedor de carteiras. E então essa sociedade desaparece, em meio a ruínas e matanças. Quer saber se esse dia se aproxima? Observe o dinheiro: ele é o barômetro da virtude de uma sociedade. Quando há comércio não por consentimento, mas por compulsão, quando para produzir é necessário pedir permissão a homens que nada produzem – quando o dinheiro flui para aqueles que não vendem produtos, mas têm influência –, quando os homens enriquecem mais pelo suborno e pelos favores do que pelo trabalho, e as leis não protegem quem produz de quem rouba, mas quem rouba de quem produz – quando a corrupção é recompensada e a honestidade vira um sacrifício –, pode ter certeza de que a sociedade está condenada. O dinheiro é um meio de troca tão nobre que não entra em competição com as armas e não faz concessões à brutalidade.

– Ele não permite que um país sobreviva se metade é propriedade, metade é produto de saques. Sempre que surgem destruidores, a primeira coisa que destroem é o dinheiro, pois ele protege os homens e constitui a base da existência moral. Os destruidores se apossam do ouro e deixam em troca uma pilha de papel falso. Isso destrói todos os padrões objetivos e põe os homens nas mãos de um determinador arbitrário de valores. O dinheiro é um valor objetivo, equivalente à riqueza produzida. O papel é uma hipoteca sobre riquezas inexistentes, sustentado por uma arma apontada para aqueles que têm de produzi-las. O papel é um cheque emitido por saqueadores legais sobre uma conta que não é deles: a virtude de suas vítimas. Cuidado que um dia o cheque é devolvido, com o carimbo “sem fundos”.

Francisco encarou os convidados e continuou:

– Se o senhor faz do mal um meio de sobrevivência, não é de esperar que os homens permaneçam bons. Não é de esperar que continuem a seguir a moral e sacrifiquem suas vidas para proveito dos imorais. Não é de esperar que produzam, quando a produção é punida e o saque é recompensado. Não pergunte quem está destruindo o mundo: é o senhor. O senhor vive no meio das maiores realizações da civilização mais produtiva do mundo e não sabe por que ela está ruindo a olhos vistos, enquanto amaldiçoa o sangue que corre pelas veias dela: o dinheiro. O senhor encara o dinheiro como os selvagens o faziam e não sabe por que a selva está brotando nos arredores das cidades. Em toda a história, o dinheiro sempre foi roubado por saqueadores de diversos tipos, com nomes diferentes, mas cujo método sempre foi o mesmo: tomá-lo à força e manter os produtores de mãos atadas, rebaixados, difamados, desonrados. Essa afirmativa de que o dinheiro é a origem do mal, que o senhor pronuncia com tanta convicção, vem do tempo em que a riqueza era produto do trabalho escravo – e os escravos repetiam os movimentos que foram descobertos pela inteligência de alguém e durante séculos não foram aperfeiçoados. Enquanto a produção era governada pela força e a riqueza era obtida pela conquista, não havia muito que conquistar.

– Para glória da humanidade, houve, pela primeira e única vez na história, uma nação de dinheiro – e não conheço elogio maior aos Estados Unidos do que esse, pois ele significa um país de razão, justiça, liberdade, produção, realização. Pela primeira vez, a mente humana e o dinheiro foram libertados, e não havia fortunas adquiridas pela conquista, mas só pelo trabalho, e, em vez de homens da espada e escravos, surgiu o verdadeiro criador de riqueza, o maior trabalhador, o tipo mais elevado de ser humano – o self-made man –, o industrial americano. Se me perguntassem qual a maior distinção dos americanos, eu escolheria – porque ela contém todas as outras – o fato de que foram eles que criaram a expressão “fazer dinheiro”. Nenhuma outra língua, nenhum outro povo jamais usara essas palavras antes, e sim “ganhar dinheiro”. Antes, os homens sempre encaravam a riqueza como uma quantidade estática, a ser tomada, pedida, herdada, repartida, saqueada ou obtida como favor. Os americanos foram os primeiros a compreender que a riqueza tem que ser criada. A expressão “fazer dinheiro” resume a essência da moralidade humana, porém foi justamente por causa dessa expressão que os americanos eram criticados pelas culturas apodrecidas dos continentes de saqueadores. O ideário dos saqueadores fez com que pessoas como o senhor passassem a encarar suas maiores realizações como um estigma vergonhoso, sua prosperidade como culpa, seus maiores filhos, os industriais, como vilões, suas magníficas fábricas como produto e propriedade do trabalho muscular, o trabalho de escravos movidos a açoites, como na construção das pirâmides do Egito. As mentes apodrecidas que afirmam não ver diferença entre o poder do dólar e o poder do açoite merecem aprender a diferença na sua própria pele, que, creio eu, é o que vai acabar acontecendo. Enquanto pessoas como o senhor não descobrirem que o dinheiro é a origem de todo o bem, estarão caminhando para sua própria destruição. Quando o dinheiro deixa de ser o instrumento por meio do qual os homens lidam uns com os outros, então os homens se tornam os instrumentos dos homens. Sangue, açoites, armas – ou dólares. Façam sua escolha, o tempo está se esgotando.

A promessa de Boulos

Guilherme Boulos cresceu nas pesquisas para a Prefeitura de São Paulo. Na eleição presidencial, fora apenas o 10.º colocado, afetado pelo voto útil. Hoje, Boulos se consolida como o candidato da esquerda, já lidera entre os mais jovens e demonstra chances reais de chegar ao 2.º turno. Suas promessas são simpáticas, mas por enquanto são promessas incumpríveis.

Se a utopia pode fazer bem a uma candidatura que só marca posição, agora o candidato do PSOL deve ser cada vez mais desafiado a mostrar a factibilidade dos seus planos. Comecemos com o importante debate da renda básica. Mais de 3 milhões receberam em São Paulo o auxílio emergencial que acaba este ano e precisam de uma solução.

Boulos promete que seu primeiro ato será instituir uma renda básica imediata – talvez de R$ 350. Mas nenhum prefeito pode fazer isso por simples decreto: esse aumento de gastos precisa ser autorizado por lei e passar pelo Legislativo. Não para aí: a Lei de Responsabilidade Fiscal exige para esse tipo de benefício mostrar de onde vem o dinheiro (uma redução permanente de outra despesa ou um aumento permanente de receita).

Mesmo que estivesse disposto a propor aumento de imposto, há outra complicação. Ainda que a Câmara Municipal aprove, ele só poderá ser cobrado a partir do ano seguinte – conforme manda a Constituição. O que Boulos pode fazer no primeiro dia é simplesmente apresentar um projeto, que terá de ser duramente negociado com o Legislativo cortando despesas ou aumentando impostos – e assim com valores significativos só a partir de 2022.

Boulos contorna as limitações com um discurso simplista sobre os devedores da Prefeitura.

Boulos contorna as limitações com um discurso simplista sobre os devedores da Prefeitura.

A campanha admite não saber quanto custa a promessa do passe livre, que é importante para os desempregados. Os opositores de Boulos afirmam que o passe livre e a renda básica custarão cerca de R$ 25 bilhões por ano. Significaria achar orçamento na cidade para um valor próximo ao custo do Bolsa Família em todo o Brasil.

Boulos defende haver R$ 17 bilhões parados no caixa da Prefeitura, o que já foi desmistificado pela checagem da agência Aos Fatos (o dinheiro tem destinação obrigatória). Propõe aumentar o IPTU de mansões, mas admite que arrecadação seria simbólica.

Se o PSOL costuma defender o aumento da tributação dos mais ricos, de fato há pouco espaço para isso no âmbito municipal. É a União que pode cobrar tributos sobre a renda (IRPF), lucro (CSLL, IRPJ) e riqueza (IGF, nunca instituído). E é o Estado que pode arrecadar com heranças e benesses (ITCMD).

Boulos contorna essa limitação com um discurso simplista sobre os devedores da Prefeitura. Mas é sabido que não se trata bilhões de guardados em um pote. Parte dos valores não têm como ser recuperados (ex: empresas falidas), e a dívida ativa é um estoque, enquanto as despesas prometidas são um fluxo que se repetirá todo ano. Por fim, se os procuradores da cidade já recebem honorários sobre as dívidas que conseguem recuperar na Justiça, como aceitar que a recuperação seja uma questão de vontade?

Soluções mais efetivas seriam uma reforma tributária e uma reforma previdenciária municipal. É possível aumentar o IPTU e o ITBI de forma progressiva, tributando mais os imóveis de maior de valor, e rever a tributação fixa do ISS (imposto sobre serviços) sobre autônomos. Não é justo que profissionais que ganhem milhões paguem o mesmo ISS do que os que ganham pouco.

Boa parte da renda subtributada no Brasil é resultado da combinação do imposto de renda e ISS amigáveis. O imposto sobre serviços fixo é generoso e gera alíquotas efetivas ínfimas para faturamentos altos.

Talvez pelo estereótipo injusto de invasor de propriedades, Boulos evite a agenda de impostos nessa campanha, mas ela é uma das saídas para suas propostas. Outra que é sensível ao PSOL é a da Previdência.

O déficit na seguridade social dos servidores é de cerca de R$ 10 bilhões e crescente, em benefício de uma minoria. Uma transferência de renda que custa o equivalente a quase 2 milhões de rendas básicas. Boa parte desse dinheiro deve se concentrar em bairros mais ricos, não na periferia.

Não é justo que uma cidade em que 3 milhões dependeram do auxílio continue permitindo que servidores que se aposentem em média ao redor dos 50 anos com os maiores salários de suas carreiras (que foram estáveis, aliás). Efeitos em curto prazo podem ser obtidos, porque ao contrário dos impostos, a contribuição previdenciária dos servidores pode ser aumentada e cobrada no mesmo ano.

Nunca é demais lembrar que o PSOL nasceu justamente como uma dissidência do PT contrária à reforma da Previdência dos servidores em 2003. Com a reforma de 2019, o tema passou a ser de competência de cada município. Boulos precisará escolher entre sua base de servidores e profissionais liberais ou a periferia da renda básica para realmente fazer diferença.

Pedro Fernando Nery, Doutor em Economia e Assessor Legislativo

https://economia.estadao.com.br/noticias/geral,a-promessa-de-boulos,70003490024

A natureza não dá a mínima para o que pensamos

O que difere os humanos dos outros seres vivos? Está aí uma simples (e difícil) questão. Desde que Charles Darwin publicou suas ideias em A origem das espécies, em 1859, as teorias sobre as diferenças entre nós e outras espécies evoluíram bastante. Quase um século depois, em 1953, a ciência da vida passou por outra revolução quando James Watson e Francis Crick, graças às descobertas de Rosalind Franklin, descobriram a estrutura do DNA.

A ironia, no entanto, é perceber que, quanto mais se sabe sobre biologia, mais difícil é explicar o que diferencia o Homo sapiens das outras espécies. São muitos os comportamentos considerados humanos que, nas últimas décadas, foram observados em outros animais. Além disso, quando o assunto é genética, parecemos ainda menos “exclusivos”, pois dividimos genes com uma gama enorme de outros organismos.

Isso explica por que a curiosidade sobre nossas particularidades (não tão particulares assim) segue viva entre muitos cientistas, entre eles o geneticista britânico Adam Rutherford. Ele estuda biologia há mais de 25 anos, pesquisando conexões e divergências entre os milhares de organismos mundo afora — e escrevendo sobre o assunto.

Em O livro dos humanos: A história de como nos tornamos quem somos, publicado em 2018 e trazido para o Brasil em 2020 pela editora Record, o autor compartilha o que descobriu em mais de duas décadas estudando o assunto. “Temos muitas características que parecem ser exclusivamente humanas, mas se olharmos mais de perto, não são. Por exemplo, fazer sexo por prazer, estados emocionais como amor e luto, sexo coersivo, necrofilia, a fabricação de ferramentas… Tudo isso já foi observado em outras espécies”, disse Rutherford, em uma conversa por telefone com GALILEU. A obra também traz reflexões sobre a evolução da ciência e fala da importância de compreendermos a natureza pelo que ela é, e não pelo que achamos que seja.

Confira a seguir entrevista completa:

Você já escreveu livros sobre diversos outros temas. Por que escolheu esse assunto para esta nova publicação?

No fim do meu último livro, Uma breve história de todas as pessoas que já viveram (2016), falo sobre o que achamos que torna os humanos excepcionais, mas ainda assim é comum em outras espécies. Eu escrevi algo como “a sensação é que se todos somos especiais, ninguém realmente é especial”. Não percebi na hora, mas essa frase veio diretamente do filme Os Incríveis, da Disney (risos). Fato é que isso plantou uma semente na minha cabeça e decidi focar no que diferencia os humanos das outras espécies.

Como foi o processo para escrever o livro?

A parte escrita em si levou cerca de dois anos, mas, para falar a verdade, estudo o assunto há 25 anos, então esse é um trabalho de muito tempo. Ah, e claro que só pude escrever esse livro graças a pesquisas feitas por gerações de humanos que existiram antes de mim. Esse é um ótimo exemplo do que concluo no livro: o que nos difere enquanto espécie é a capacidade de, a partir da comunicação, ensinar o que aprendemos.

Então, basicamente, a explicação do que nos diferencia é a capacidade de ensinar?

Exatamente! Temos muitas características que parecem ser exclusivamente humanas, mas se olharmos mais de perto, não são. Por exemplo, fazer sexo por prazer, estados emocionais como amor e luto, sexo coersivo, necrofilia, a fabricação de ferramentas… Tudo isso já foi observado em outras espécies.

Acredito que a comunicação falada também seja um dos nossos diferenciais, mas o principal é que somos uma espécie social de professores e alunos. Outros animais aprendem na prática ou copiando outros indivíduos, mas nunca foram observados fazendo o que estamos fazendo agora, por exemplo.

Eu e você nunca nos conhecemos, não somos parte da mesma família e não teremos mais chances de sobreviver por compartilhar informações. Além disso, é improvável que algum dia nos encontremos e menos provável ainda que tenhamos filhos. Não ganhamos nada, diretamente, por essa troca de conhecimentos e, ainda assim, cá estamos, compartilhando o que sabemos. É isso o que os humanos fazem.

No livro, você fala sobre os perigos de comparar outras espécies com os seres humanos. Por que isso é ruim?

Compartilhamos muitas coisas com os nossos ancestrais, como nossa bioquímica, hábitos e até alguns comportamentos, então estudar as outras espécies pode ser útil para compreendermos o ser humano. Entretanto, realizar comparações e exagerar nas conclusões pode ser perigoso, principalmente quando buscamos justificativas biológicas para comportamentos que são resultado de ideologias sociais.

Um exemplo é o trabalho do biólogo Jordan Peterson, que justifica o patriarcado entre os humanos porque ele existe em outras espécies, como as lagostas. Ora, mas por que lagostas? Por que não os bonobos? Eles são muito mais próximos de nós evolutivamente que as lagostas — e têm sociedades matriarcais. Quando você olha para a natureza, pode escolher qualquer comportamento humano e justificá-lo por sua existência em suas espécies, e isso nem sempre é verdade. Na realidade, é um tanto desonesto cientificamente.

Ao mesmo tempo, enquanto conversamos, meu cachorro está me olhando com uma carinha de “com quem você está falando?”

(Risos) É, nós tendemos a antroporfomizar animais. O curioso dos cães, por exemplo, é que mesmo sem fazer de propósito, influenciamos sua evolução: selecionamos como pets os cachorros mais expressivos, que mexem as sobrancelhas e parecem expressar emoções. Isso não acontece com seus parentes caninos, os lobos.

Esse hábito é natural e não tem problema, quer dizer, queremos assistir aos filmes da Disney numa boa. O problema é quando começamos a cofundir as coisas. Por exemplo, os golfinhos aparentam ser “simpáticos” porque parecem estar sorrindo, mas, na verdade, têm algumas práticas bem cruéis, como o sexo coercitivo. A natureza não dá a mínima para o que pensamos, não podemos impor nossas normas aos animais.

Por que é errado fazer isso?

Quando comparamos o sexo coercitivo dos golfinhos com estupro, por exemplo, estamos impondo nossos valores sobre os animais, e isso causa vários problemas. Primeiro de tudo porque na natureza não existem valores morais, pelo menos não como os conhecemos. Segundo porque sabemos que o estupro está longe de ser algo justificável pela biologia, é um comportamento resultante de ideologias sociais. Logo, comparar essas duas situações é um erro.

Você acredita que esses mal-entendidos, em partes, têm a ver com ideias erradas sobre a teoria da evolução?

A teoria da evolução por seleção natural é a ideia mais poderosa que já existiu — o problema é que as pessoas tendem a acreditar que tudo pode ser explicado por ela. Nem todas as características ou comportamentos existem para ou por causa de algo. A grande maioria das coisas na biologia simplesmente acontecem, são neutras. Mas temos essa ideia de que “tudo na natureza acontece por um motivo”.

Isso não contece apenas quando o assunto é evolução. O próprio Voltaire escreveu sobre isso em Cândido (1759). Não sobre evolucionismo, mas sobre a necessidade que temos de acreditar que há um motivo para tudo, quando, na verdade, não funciona assim. Essa forma de pensar leva até a mídia e os pesquisadores a deduzirem informações falsas sobre o assunto.

Na sua visão, qual será a próxima grande revolução na biologia?

Essa é uma ótima pergunta, um tanto difícil. Minha resposta é: não acredito que ocorrerá propriamente uma revolução, mas sim uma melhora na forma como estudamos a biologia. Ela será mais inclusiva e abrangente. Vou explicar melhor. Por conta do racismo e do sexismo estruturais, os europeus foram muito mais estudados do que qualquer outro povo no mundo, e isso é um problema se considerarmos que grande parte dos hominídeos surgiram na África.

Nós, pesquisadores, sabemos disso e queremos estudar povos de todo o mundo, mas precisamos fazê-lo da forma correta. Não podemos criar um tipo de “colonialismo científico”, ou seja, não podemos ir até determinada população, coletar o que precisamos e ir embora. O que devemos fazer é trabalhar em conjunto com os locais, em parceria.

We’re on  hits

hits

6 Professores que Ganham Mais que o Neymar

Assim como Neymar, inúmeros professores também tornaram-se uma empresa. Ao contrário do adulto Ney, que produz entretenimento, eles tornam a educação mais acessível.

A contratação de Neymar pelo francês Paris Saint-Germain caiu como uma verdadeira bomba no mundo do futebol. Pelos valores envolvidos no negócio, trata-se da mais cara transação já realizada na história desse esporte.